Entrevista a Manuel Fernández Guasti: ‘(…) nos dimos cuenta de que había pocas verificaciones del principio de Heisenberg’

POR: Héctor M. Magaña

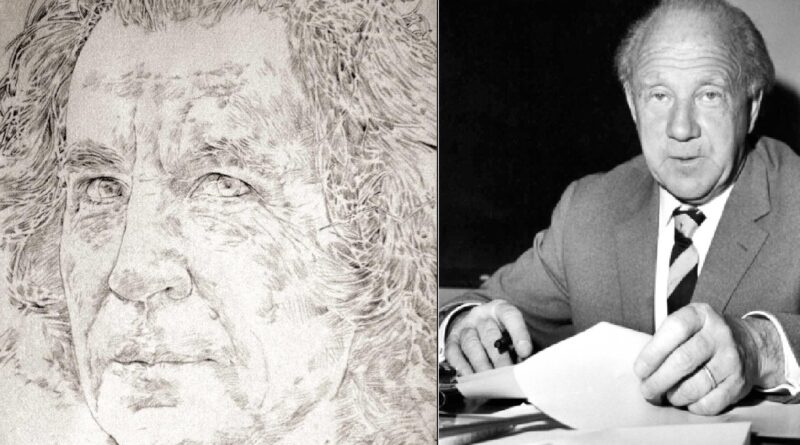

Izquierda: Manuel Fernández Guasti dibujado por artista veracruzano Ramón Marín. Derecha: Werner Heisenberg en 1961.

El próximo año se celebrarán 100 años desde que un joven profesor alemán de física, Werner Heisenberg, publicara un artículo que revolucionaría la ciencia. Dicha revolución nos continúa sorprendiendo y maravillando hoy en día. Como si de una inspiración se tratase, Heisenberg llegó a su famoso Principio de Incertidumbre durante unas vacaciones en la isla de Heligoland en 1925. En aquel tiempo, como asistente de investigación de Niels Bohr, Heisenberg luchaba por compatibilizar los datos registrados con un modelo atómico viable. Armado con un libro de poemas de Goethe y con una sólida formación matemática a sus espaldas, se dejó llevar por el clima suave y la tregua de una alergia que lo aquejaba. La idea del álgebra matricial se forjó ahí y el resto es historia.

En diciembre de 2025, un físico mexicano ha verificado dicho principio. El doctor Manuel Fernández Guasti tiene una carrera sólida como físico experimental en la Universidad Autónoma Metropolitana (UAM) Iztapalapa; tras siete años de preparación, su equipo logró publicar un artículo que “robustecerá” la física y potenciales investigaciones futuras. El pasado 16 de enero de 2026 tuvimos la oportunidad de hablar con el Dr. Guasti, y diversos temas salieron a flote: su historia académica, la mecánica cuántica, su historia y desarrollo, al igual que diversos aspectos sobre la ciencia en nuestro país y su futuro.

La entrevista se celebró por vía Zoom. Hablar con el Dr. Guasti nos ha recordado que, como bien había dicho Ernst Mach (casi en la misma época que Max Planck) y posteriormente Karl Popper, la ciencia no se puede pronunciar sobre la realidad última. La ciencia, como estructura, es una construcción siempre en reformas y, como tal, el Dr. Guasti y su equipo han contribuido con los ladrillos necesarios para su avance.

Héctor Magaña (HM): Buenas tardes, Dr. Guasti. Muchas gracias por tomarse el tiempo para concedernos esta entrevista. Personalmente, me enteré de su trabajo a través de algunos artículos en diversos diarios. Salta a la vista la importancia que tiene este trabajo, tanto por sus resonancias históricas como culturales. Nuevamente, muchas gracias.

Manuel Fernández Guasti (MFG): Muchas gracias.

HM: Quisiera comenzar esta entrevista preguntándole por su trayectoria académica. Tengo entendido que cuenta con una larga carrera como físico experimental.

MFG: Es importante lo que me mencionas al inicio: la cuestión de si soy un físico experimental. Yo, de hecho, tengo tarjetas de presentación que así lo indican. En décadas pasadas se hizo una división entre físicos teóricos y físicos experimentales. En mi opinión, esto no ha abonado para el progreso de la física. Considero que los físicos debemos poder movernos como pez en el agua tanto en el ámbito teórico como en el experimental.

En la parte experimental esto es muy claro, ya que prácticamente no se pueden hacer experimentos si no se tiene una claridad teórica importante; de otro modo, uno no sabría qué medir o qué experimentos realizar. Por otra parte, en el ámbito teórico, si observamos a los grandes exponentes de la física (por ejemplo, Max Planck), vemos que cuando desarrolla su primera publicación sobre la cuantización del elemento de energía, se basaba en los resultados experimentales de sus colegas. Estaba muy atento a lo que sucedía en el mundo experimental.

En la actualidad, desafortunadamente, tenemos colegas que no mantienen ningún vínculo con la observación experimental. Eso no ayuda mucho. Es muy importante que los jóvenes investigadores que se están formando no se conciban como especialistas cerrados, sino que traten de ser competentes en ambas áreas.

HM: Revisando su currículum, se observan ambas vertientes: física experimental y física teórica. Si no me equivoco, ha trabajado con sistemas complejos y de alta energía. Al revisar su perfil en Google Scholar se aprecia claramente esto. ¿Podría compartirnos, a grandes rasgos, en qué consiste su carrera? Vemos, por ejemplo, un trabajo importante centrado en óptica y nos gustaría conocer más al respecto.

MFG: Yo estudié —tuve la fortuna— en la fundación de la UAM Iztapalapa, en la primera generación, de 1974 a 1978. Fue una época maravillosa: teníamos a los mejores profesores de física del país de esa época. Realicé mi doctorado en la Universidad de Oxford, en óptica no lineal, y posteriormente me invitaron a regresar a la UAM Iztapalapa para incorporarme como profesor. Fundé el Laboratorio de Óptica Cuántica, donde continúo trabajando hasta la fecha.

He pasado muchos años en el laboratorio. Mi trabajo ha oscilado entre la física aplicada —como el desarrollo de láseres de distintos tipos: de nitrógeno molecular, láseres de pigmentos orgánicos, holografía y técnicas holográficas, así como óptica no lineal— y desarrollos más abstractos o matemáticos, como el estudio de álgebras hipercomplejas. Esa es otra vertiente en la que también trabajo.

HM: Me gustaría dar un pequeño salto en el tiempo —luego recapitularemos—. El experimento de la comprobación del Principio de Incertidumbre de Heisenberg, por lo que he leído en otros periódicos como La Jornada, no ha sido el primero; se han realizado otras comprobaciones. ¿Qué lo motivó a ofrecer una nueva “perspectiva” o “visión” con esta comprobación? ¿Cómo se planeó el experimento?

MFG: Es una pregunta muy interesante. Nosotros no teníamos planeado realizar una comprobación del Principio de Incertidumbre de Heisenberg. Estábamos llevando a cabo un experimento cuyo propósito era estudiar la decoherencia cuántica. En computación cuántica, uno de los principales cuellos de botella es precisamente este problema de la decoherencia.

Desde el punto de vista de la óptica, la decoherencia se ha estudiado tradicionalmente de manera estadística: se habla de promedios, correlaciones de ensamble, etcétera. Nosotros pensábamos que era necesario seguir esa relación en el tiempo dentro de nuestro sistema y no limitarnos a describir lo que ocurre en promedio, sino observar qué sucede en la sucesión temporal.

Planeamos el experimento para resolver la interferencia —una medida de la decoherencia— tanto en el espacio como en el tiempo. Estábamos trabajando en ello cuando nos dimos cuenta de que este mismo montaje podía utilizarse para comprobar el Principio de Heisenberg. Fue entonces cuando decidimos realizar esa corroboración.

HM: ¿En qué concluyó el otro experimento, el original, de decoherencia?

MFG: Sigue abierto. Resolver la interferencia tanto en posición como en tiempo es un tema muy rico, con muchas vertientes. Creo que hay ahí una mina de trabajo.

HM: Retomando algunos de sus otros trabajos, por ejemplo en holografía, vienen a la mente físicos como David Bohm. Esto remite a los llamados “padres fundadores” de la física cuántica: Max Planck, David Bohm, Heisenberg, Bohr, etc. La mayoría de quienes no pertenecemos al mundo académico estamos acostumbrados a lecturas que resaltan los logros de los años veinte y las disputas entre estos grandes físicos. Mi pregunta es: ¿ha cambiado demasiado el paradigma de la física de los años veinte con los descubrimientos actuales?

MFG: Esa es una gran pregunta. La mecánica cuántica tiene dos periodos importantes. El primero comienza en 1901, cuando Planck publica su artículo en el que postula la existencia de elementos discretos de energía, y se extiende hasta 1927, cuando Erwin Schrödinger establece su ecuación de onda. A este periodo lo llamamos “teoría cuántica vieja”.

Dentro de esta teoría cuántica vieja hay dos etapas: de 1901 a 1913, en las que solo se cuantiza la energía; no se cuantiza ninguna otra magnitud. En la primera Conferencia Solvay, en 1911, los físicos más destacados de la época reconocen que la propuesta de Planck es sólida. Sol hasta 1913, Niels Bohr propone la cuantización del momentum angular, lo que permite abordar las líneas espectrales de los átomos. Ese es el segundo gran éxito de la teoría cuántica vieja.

A partir de ahí comienzan a aparecer diversas limitaciones. Físicos como Arnold Sommerfeld y Paul Ehrenfest trabajan intensamente en estos problemas. Ehrenfest, en particular, introduce una noción estadística que empieza a cobrar fuerza.

Entre 1926 y 1927, Heisenberg y otros colegas proponen el formalismo matricial, y casi al mismo tiempo, Schrödinger propone un formalismo ondulatorio (su ecuación es una ecuación de onda). En principio, estos dos formalismos parecen entrar en conflicto, pero Schrödinger —un científico verdaderamente extraordinario— se da cuenta de que ambos son equivalentes. Cuando se empieza a formar esa lucha, él establece que son formalismos equivalentes.

Desde entonces se consolidan distintas visiones sobre cómo interpretar la mecánica cuántica. Los resultados matemáticos del álgebra matricial y de la ecuación de onda son los mismos, pero la interpretación difiere, y sorprendentemente esta cuestión interpretativa no se ha resuelto hasta hoy. A veces se cuenta como broma que alguien pregunta: “Bueno, ¿y cómo se interpreta esto?”, y otro responde: “¡Cállate y sigue calculando!”. Mientras calcules no pasan nada, pero si interpretas la cosa cambia. También se dice que no hay dos físicos que interpreten la mecánica cuántica de la misma manera.

La visión de Louis de Broglie es muy afín a una interpretación ondulatoria, en resonancia con Schrödinger, mientras que Bohr y Heisenberg enfatizan la discretización. La interpretación más exitosa, al momento de explicar las cosas, ha sido la de Copenhague: una visión estadística de fenómenos discretos. Prevalece hasta nuestros días, aunque nos deja incómodos en muchos aspectos pero no hemos logrado aún una alternativa interpretativa plenamente satisfactoria.

HM: Es interesante lo que nos comenta porque, precisamente, la interpretación de Copenhague ha sido muy criticada desde diversos puntos de vista. Por mencionar a dos famosos: Karl Popper y Mario Bunge en Latinoamérica. Por ello, saltando un poco en el tiempo, me gustaría preguntar: ¿Qué sucedió en el laboratorio de la UAM en diciembre de 2025? ¿Cómo fue la preparación de siete años? Esto es importante porque, recordando un poco la cita del filósofo Bruno Latour: “Dame un laboratorio y levantaré el mundo”.

MFG: Retomando un poco antes. Aunque desconozco a Bruno Latour, hay un par de cosas que quiero mencionar. Mencionaste a Mario Bunge; un hijo de Mario es el Dr. Carlos Bunge, que trabaja en el Instituto de Física de la UNAM. Carlos, un investigador maduro y experimentado, está muy interesado en los fundamentos de la mecánica cuántica. Yo me he enriquecido con amplias discusiones con Carlos Bunge; nos reunimos periódicamente a discutir las visiones que vamos desarrollando cada uno de nosotros. No existen muchos físicos que se dediquen a los fundamentos de la mecánica cuántica; hay quienes están interesados en las aplicaciones, pero los fundamentos, no tanto. Gracias a Carlos tengo la posibilidad de discutir dichos fundamentos.

La segunda cosa que me gustaría mencionar es, sobre la visión de la escuela de Copenhague: en el artículo que publicamos sobre la medición del principio de incertidumbre vemos los resultados, vemos que lo corrobora y tomamos el límite cuando ℏ tiende a 0; ese límite nos lleva al límite clásico, el límite no cuántico. Mostramos que si tomamos ese límite nos lleva al límite clásico. Hay una frase que está al final del artículo: “Sin embargo, hay esa posibilidad que en la desigualdad cancelemos la constante de Planck de ambos lados de la desigualdad” y, en ese caso, nos quedemos con una desigualdad que no depende de ℏ. Al no depender de ℏ, a donde nos lleva es que esa desigualdad se debe a una cuestión ondulatoria. Cuando llegamos al final del artículo estamos contraponiendo las dos cosas. Por un lado vemos esta desigualdad como un problema de cuantización, pero por otro lado se puede ver como incertidumbre debido a un fenómeno ondulatorio.

HM: Recordando el libro Física y filosofía (1958) de Werner Heisenberg, muestra un mundo “fracturado” entre el mundo clásico y el mundo cuántico, en contraposición a Einstein, que buscaba la unidad del mundo. ¿Se mantiene su visión del mundo “fracturado”?

MFG: Es bueno que hables de Heisenberg y de este libro en particular. Es muy importante. Cuando él publica el artículo sobre el principio de incertidumbre, describe una relación en donde la incertidumbre en posición y en momentum están en un límite que es “más o menos ℏ”. Matemáticamente él describe ese “más o menos”. No pone una medida rígida. No es sino hasta uno o dos años después, cuando Hermann Weyl define las incertidumbres como desviaciones estándar y pone una definición matemática estricta. Durante años Hermann Weyl fue considerado como un corrector de Heisenberg y colocó esto de forma estricta. En fechas recientes he considerado que la visión de Heisenberg fue una visión de muy largo aliento. Cuando él establece ese “más o menos” y no le da ese “rigor” matemático coloca una cuestión que depende, en mayor medida, de cómo se establezcan las incertidumbres. Ese hecho, de haber dejado un poco suelto cómo establecer las incertidumbres, fue en realidad una virtud. El rigor es una cuestión que hay que pensar mucho.

HM: Es curioso que mencione esto porque Heisenberg tuvo formación de matemático. Escogió a Max Born después de que su director de tesis para su doctorado falleciera. Gracias a su formación matemática es precisamente que introduce el álgebra matricial.

Modelo conceptual del experimento

MFG: La álgebra matricial era algo muy nuevo. Era algo casi exclusivo de los matemáticos. Fue algo que sucedió posteriormente. Pero me gustaría retomar la cuestión anterior. Quiero dar más énfasis en cómo hicimos el experimento. En entrevistas previas nos centramos en los resultados. En este “cómo” es, para nosotros, establecer interferencia entre dos haces de luz o dos haces de fotones necesitamos tener dos frecuencias. Estas dos frecuencias, si las tratábamos de obtener de una misma fuente o de un mismo láser, podrían tener una correlación entre ellas y el formalismo es muy nítido si no hay ninguna correlación entre los dos modos. La única solución que teníamos era trabajar con dos láseres que fueran completamente independientes. Eso fue lo que decidimos hacer. Claro, si le preguntáramos a un colega de óptica: “Si tomo dos láseres y los pongo a interferir, ¿veo franjas de interferencia?”, te dirá que no, porque las fluctuaciones estocásticas de un láser y de otro hacen que no se vean franjas de interferencia. Lo que se requiere para poder verlas son dos cosas: por un lado, que los dos láseres sean extremadamente estables para que se minimicen las fluctuaciones (no se pueden eliminar, pero se pueden reducir); y, por otro lado, que el sistema de detección se pueda resolver tanto espacial como temporalmente. Algo que resuena con lo que mencionábamos al principio. Ello crea lo que se conoce como “fenómeno de batido”, que es interferencia resuelta en el tiempo. Entonces, ahí empezaron nuestros dolores de cabeza [risas] al estabilizar los dos láseres para lograr interferencia entre ellos. Lo que tuvimos que hacer fue desconectar los mecanismos que tenían de estabilidad de temperatura para, desde fuera, controlar la temperatura de los láseres y, cambiando la temperatura, sintonizar el láser y poder acercar las dos frecuencias para que se superpusieran y poder ver la interferencia. Eso es lo que nos llevó siete años. Fue un proceso largo y muy difícil.

HM: Me recuerda mucho cuando se detectaron los neutrones por James Chadwick, cuando se usaron contadores para detectarlos. Es interesante ver cómo se usan los láseres. Pero, comentando una cuestión “semántica”: ¿qué entendemos por Principio? La mayoría de nosotros tenemos una relación con la ciencia “muy escolar”, por así decirlo. Conocemos el clásico método científico de: observación, hipótesis, experimentación, teoría/ley, pero desconocemos en dónde queda el “Principio”.

MFG: Una pregunta muy profunda e interesante. Algo en lo que yo difiero con la visión predominante es que hablemos en términos de “leyes”. Hablamos de las leyes de la naturaleza, las leyes de la física. Cuando no se cumplen hablamos de la “violación” de las leyes. Creo que esa visión es incorrecta. Alguien que planteó de manera muy clara esta cuestión fue Moritz Schlick, quien fue un físico que se formó como estudiante de Max Planck. Presentó su tesis doctoral en 1903. Después de presentar su tesis doctoral se “encantó con la filosofía” y se dedicó más a ella; posteriormente fue el motor fundamental del Círculo de Viena. Moritz Schlick fue uno de sus fundadores. En uno de sus libros comenta que la tendencia de hablar en términos de “leyes” es incorrecta para describir la naturaleza porque lo que conocemos como leyes es algo más jurídico. Los seres humanos llegan a acuerdos entre diversas voluntades: dada mi voluntad, yo me pliego a una ley que el colectivo me impone o no; entonces, depende de mi voluntad el “obedecer” o no la ley. Moritz Schlick nos recuerda que la naturaleza no tiene voluntad. Los fenómenos físicos son lo que son. En ese caso, no están sujetos a “jurisprudencia”. Esa tendencia de obligar a la naturaleza a actuar de cierta manera es conceptualmente incorrecta. Es algo que deberíamos cambiar. Cuando decimos o hablamos de una ley, ¿qué estamos diciendo? Establecemos un modelo. Nosotros establecemos un modelo que traducimos a una ecuación matemática. Por ejemplo, la segunda “relación” de Newton. No la llamo ley, le digo “relación” porque relacionamos la fuerza con la aceleración y ambas son proporcionales, y la constante de proporcionalidad es la masa. En ese caso, lo que estamos haciendo al abstraer es usarla para establecer modelos para describir la naturaleza y, si ese modelo es muy abarcador, lo llamamos teoría y los específicos serían solo un modelo.

En el caso del Principio de Incertidumbre es una relación entre variables. Tengo el producto de incertidumbre en posición por la incertidumbre en momentum que debe ser mayor o igual a ℏ/2. Esa relación se establece y la consideramos como satisfactoria. Claro, ¿qué sucede? La diferencia entre la física y la matemática es que nosotros no podemos demostrar estos resultados. Las relaciones no son demostrables: del mismo modo que no es demostrable F = m·a. Son propuestas de relaciones y esas relaciones son verificables con lo que observamos y, en la medida que las verificamos muchas veces, es como tomamos confianza en las teorías y los modelos. Esa verificación continua robustece nuestras teorías, pero nunca sabemos si el día de mañana el experimento nos las desmiente.

En el artículo, una parte muy importante es que nos dimos cuenta de que había pocas verificaciones del principio de Heisenberg. Investigadores muy distinguidos, como Max Jammer y otros, justamente han hecho esa crítica: no tenemos prácticamente verificaciones de un principio tan importante. Eso es básico. Solo así se robustece como propuesta sólida.

Las verificaciones existentes son experimentos de difracción. Se pone una apertura y define una posición y después, en campo lejano, se mide la difracción y ahí se infiere el momentum, pero eso no es lo que nos dice el Principio de Heisenberg. Lo que dice es: “mide posición y momentum en una misma posición del espacio-tiempo”, no “mide posición en un tiempo y el momentum en otra posición y otro tiempo”. Nuestra verificación es en una misma región de espacio y tiempo.

HM: Usando una analogía un poco burda sería que en experimentos anteriores básicamente uno se concentraba en medir el objeto y otro su sombra, pero no había una simultaneidad.

MFG: Es correcto, sí.

HM: ¿Cómo ve la ciencia en general en nuestro país?

MFG: Creo que, cuando hablamos de podernos mover tanto en la teoría como en lo experimental, es un necesario un énfasis en ello al momento de desarrollar la física en México. Parece que necesitamos mucho más trabajo experimental asociado al desarrollo teórico, es decir que ambos estén estrechamente vinculados. No es raro que existan desarrollos teóricos en donde no se establece ningún vínculo con posibles resultados experimentales o aplicable, y creo que eso es muy importante. Necesitamos de ello (resultados aplicables). Para hacer física experimental se necesitan muchos más recursos y creo que es importante destinar mayores recursos a la física experimental y, claro, de una manera en que se vislumbre en cómo podrían incidir en problemas acuciantes para la sociedad. Eso es muy difícil. La ciencia aplicada no se desarrolla por sí sola. Tenemos una anécdota de Michael Faraday cuando en la Royal Society le preguntaron sobre la inducción electromagnética: “¿Para qué sirve?”. Y él contesta: “¿Para qué sirve un recién nacido?”. Una genial respuesta. Podemos vislumbrar aplicaciones, pero debemos ser cuidadosos. Otra cosa importante es cómo pueden permear los desarrollos científicos hacia la industria, es decir, cómo hacer desarrollos tecnológicos. Creo que no ha habido mucho éxito. Tenemos desarrollos, incluso cada año, pero falta un flujo entre las aplicaciones para la sociedad y un camino que nos diga hacia dónde trabajar. Algo como le pasó a Pasteur en el desarrollo científico de la vacuna. Necesitamos un trabajo más amplio en el desarrollo científico y social.

Fotografías del equipo del Dr. Guasti y su equipo en el laboratorio de física experimental de la UAM.

HM: Creo que eso sería todo. Muchas gracias por concedernos el tiempo para responder a estas inquietudes.

MFG: No, al contrario, gracias a ti.